深度求索(DeepSeek)今日发布全新系列模型

双版本布局:Pro 瞄准极致性能,Flash 注重效率

-

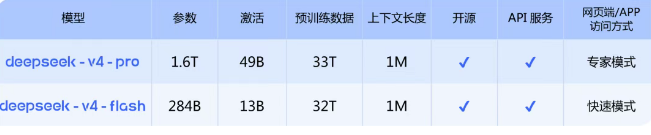

DeepSeek-V4-Pro(1.6T参数,激活49B): 对标顶级闭源模型。在 Agentic Coding 测试中位居开源阵营最佳,交付质量逼近 Opus4.6;在数学、STEM 与竞赛编程评测上,超越当前公开结果的开源模型,展现出世界顶级的推理实力。

-

DeepSeek-V4-Flash(284B参数,激活13B): 主打极致性价比。尽管世界知识覆盖略逊于 Pro 版,但在简单任务的推理能力与 Agent 表现上与 Pro 版不相上下,可提供更快捷、更经济的 API 服务。

架构突破:DSA 机制让长上下文更普惠

深度适配 Agent 生态

面向当前常见的 Agent 产品(如 Claude Code、CodeBuddy 等),reasoning_effort 参数,用户可根据任务难度调节思考强度(high/max),在代码生成和文档处理等复杂场景中表现更稳更强。

访问与开源计划

目前,大家可通过deepseek-chat 与 deepseek-reasoner 模型名将于三个月后(2026 年 7 月 24 日)停用。

-

开源链接: 已在

Hugging Face 魔搭社区 -

技术报告: 同步披露于

Hugging Face

此次

-

DeepSeek-V4模型开源链接:

https://huggingface.co/collections/deepseek-ai/deepseek-v4

https://modelscope.cn/collections/deepseek-ai/DeepSeek-V4

用户38505528 7个月前0

粘贴不了啊用户12648782 8个月前0

用法杂不对呢?yfarer 8个月前0

草稿id无法下载,是什么问题?