随着大型语言模型(LLM)在推理时对算力的需求持续上升,传统服务方式逐渐遇到瓶颈。Moonshot AI 与清华大学联合团队近期提出了一种全新方案 —— 预填充即服务(PrfaaS),目标是在大型语言模型服务中打破对数据中心和计算资源的既有限制。

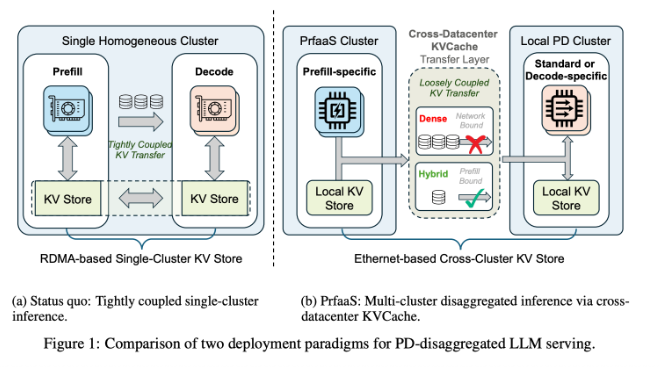

目前,LLM 的推理一般分为预填充和解码两个阶段。预填充是读取输入并生成键值缓存(KVCache)的高算力环节;解码则是逐字生成输出、更加吃内存带宽的环节。传统做法通常在同一数据中心完成这两步,容易在计算与带宽上同时受限。

PrfaaS 将预填充任务卸载到专用的高算力集群,通过通用以太网把生成的 KVCache 传回本地的解码集群,从而实现跨数据中心的高效协同。研究结果显示,这一架构在处理能力上有明显提升,相比传统方式,整体服务吞吐量提高了 54%。在实际案例中,该方案还带来了更低延迟与更高效率。

在架构设计上,PrfaaS 将计算、网络与存储三个子系统解耦管理,通过精细的路由策略确保长请求高效传输,避免了以往因资源分配不均导致的拥塞。同时,系统加入双时间尺度的调度机制,适配不同的流量变化,进一步提升资源利用率。

随着跨数据中心推理需求增长以及新硬件不断出现,PrfaaS 为未来的 AI 应用提供了一条值得关注的新路径。

© 版权声明

AI智能体所有文章,如无特殊说明或标注,均为本站作者原创发布。任何个人或组织,在未征得作者同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若此作者内容侵犯了原著者的合法权益,可联系客服处理。

THE END

用户38505528 7个月前0

粘贴不了啊用户12648782 8个月前0

用法杂不对呢?yfarer 8个月前0

草稿id无法下载,是什么问题?