现阶段的AI看图,其实还藏着一个不太起眼的短板。

问它“这张图里有什么”,它能说得清清楚楚;可要是问“图中那只熊猫的左后腿在哪里”,它就容易打太极。这并不是个别模型的问题,而是视觉-语言大模型长期的通病——全局理解强,细节定位弱。

谷歌DeepMind在最新论文里提出了TIPSv2,用来专门啃这块硬骨头。

团队调研时发现了一个有点反直觉的现象:在精细分割任务中,参数更少的“学生模型”常常压过体量更大的“教师模型”。原因在于,蒸馏把遮盖机制去掉了,模型被迫学习整张图的全部细节,于是形成“全区域监督”。受此启发,TIPSv2围绕这个发现做了三处关键改进。

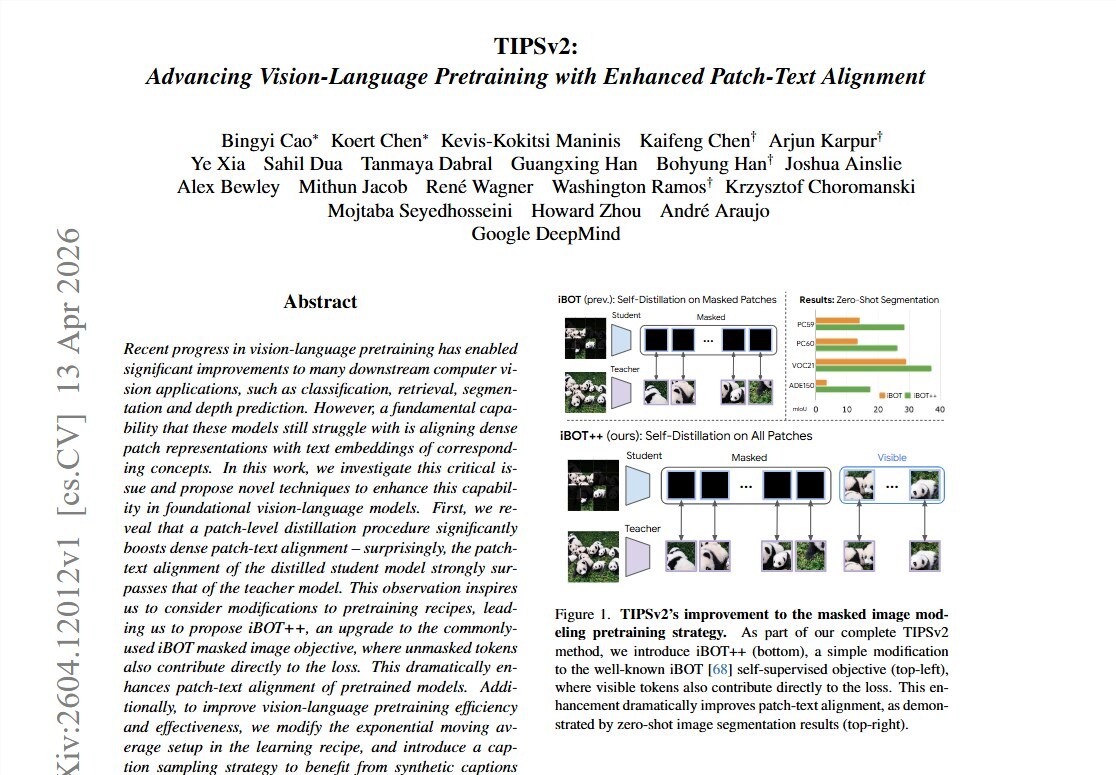

第一项是 iBOT++。传统的预训练只在被遮住的区域计算损失,可见区域几乎放任不管,局部语义就容易漂。iBOT++要求对所有可见区域都进行精确监督,相当于从“猜谜”升级为“精读全文”。仅这一改动,零样本分割就直接提升了14.1个百分点。

第二项是 Head-only EMA。以往的自监督训练需要在显存里同时保留两份几乎相同的大模型,开销很大。TIPSv2发现,图文对比损失本身就能稳定主干网络,因此EMA只作用在最后的投影头,主干不用复制。结果是训练时需要维护的参数规模直接减少约42%,速度更快,性能几乎不掉。

第三项是多粒度文本组合。训练时把网页的短描述、中等长度描述,以及Gemini生成的长描述混合随机喂给模型,难易交替,既防止任务太简单让模型“偷懒”,也能保证细节不丢。

最终效果很扎实。TIPSv2在9大任务、20个权威数据集上完成冻结评测,零样本语义分割刷新业界最优,图文检索与分类超过了参数量比自身大56%的对比模型,纯视觉任务也全面跻身前列。

目前TIPSv2的代码和模型权重已经全部开源。面对医疗影像、自动驾驶、工业检测等需要高精度图像理解的场景,这套方案值得认真上手评估。

论文地址:https://www.alphaxiv.org/abs/2604.12012

用户38505528 9个月前0

粘贴不了啊用户12648782 10个月前0

用法杂不对呢?yfarer 10个月前0

草稿id无法下载,是什么问题?