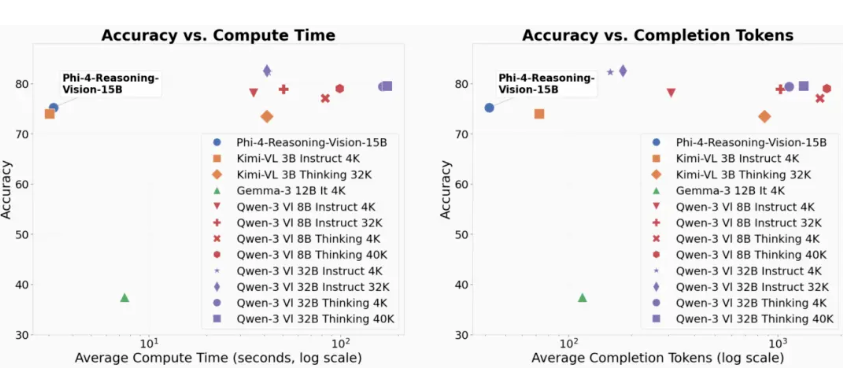

微软近日将其最新打造的多模态推理模型 Phi-4-reasoning-vision-15B 开源发布。凭借 15B 参数规模,它在保持小体量的同时做到性能强、成本低,成为算力受限环境里处理复杂视觉任务的又一选择。

精细数据加持的“小钢炮”

不同于业内动辄使用万亿级 token 训练的大模型,Phi-4-reasoning-vision 仅以约 200B 多模态 token 完成训练。研发团队把“数据质量”放在首位:一方面深度清洗开源数据,另一方面定向生成合成数据,并通过精细配比不同领域的数据(例如增加数学数据的占比,也能带动计算机操作能力提升),让模型在科学推理与屏幕定位等任务上表现突出。

混合推理的新思路

这款模型的一大亮点,是引入“混合推理路径”的设计:

-

感知任务: 处理图像描述、OCR 等较简单的场景时,默认走“直接作答”路径,降低响应延迟。

-

推理任务: 遇到数学公式、科学图表等需要复杂逻辑的内容时,会自动调用结构化思维链(CoT)流程,提升答案的准确性。

用户也可通过特定提示词,在两种模式间手动切换,以匹配不同应用。

得益于 SigLIP-2 动态分辨率编码器的加入,该模型对高分辨率截图中的细微元素非常敏感。这使它成为开发计算机使用助手(CUA)的理想之选,能够精准识别并操作网页或手机界面上的按钮与输入框。

目前,Phi-4-reasoning-vision-15B 已在多家开源平台上线。微软希望借助这款紧凑模型证明,在多模态领域,“更小、更快”也能与“更强”并行,进一步推动空间智能与实时交互技术的普及。

© 版权声明

AI智能体所有文章,如无特殊说明或标注,均为本站作者原创发布。任何个人或组织,在未征得作者同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若此作者内容侵犯了原著者的合法权益,可联系客服处理。

THE END

用户38505528 9个月前0

粘贴不了啊用户12648782 10个月前0

用法杂不对呢?yfarer 10个月前0

草稿id无法下载,是什么问题?