在当下的工业级推荐系统中,基于大语言模型(LLM)的“生成式检索(GR)”正逐步取代传统的嵌入式/向量检索。但在真实落地时,一个难题常被遇到:模型容易“瞎编”,会生成不存在的商品ID,甚至违背库存等业务约束。

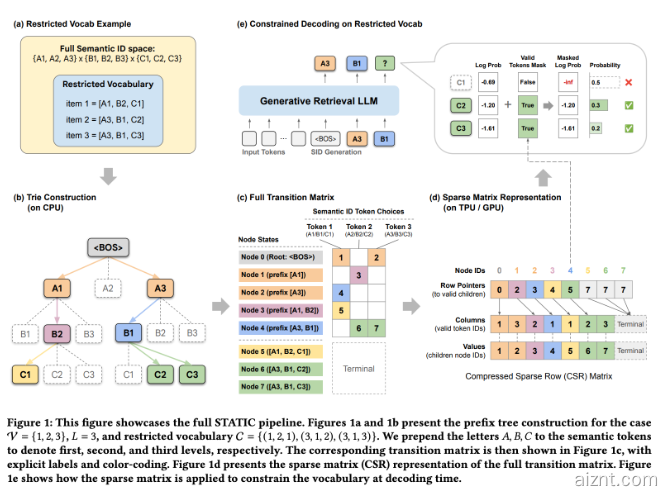

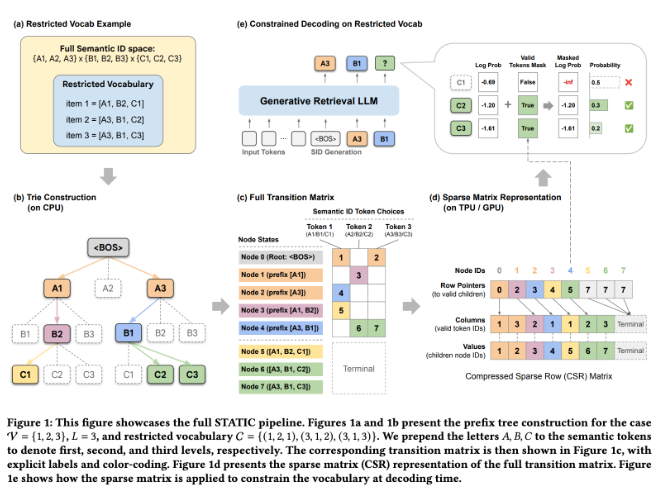

为化解这一痛点,Google DeepMind 携手 YouTube 研究团队推出了全新框架 STATIC(用于约束解码的稀疏转移矩阵加速 Trie 索引)。借助创新的数学设计,这项技术将 LLM 的约束解码提速到惊人的948倍。

核心技术突破:

-

把“树”变“阵”:传统约束校验多依赖前缀树(Trie),但在 GPU/TPU 等硬件上效率不佳。STATIC 将复杂的树结构压平成静态压缩稀疏行(CSR)矩阵,把校验过程改写为硬件更擅长的向量化计算。

-

极致响应速度:在30亿参数模型的测试中,STATIC 的单步延迟仅0.033毫秒。相较传统 CPU 检索,速度接近千倍提升;对比已有硬件加速方案,也快出40倍以上。

-

YouTube 实测亮眼:该技术已在 YouTube 视频推荐上线,用于保证推荐命中“近7天新鲜度”等业务规则。实测显示,新增/新鲜视频的播放量提升5.1%,点击率(CTR)也显著增长。

此外,STATIC 还补齐了生成式检索在“冷启动”阶段的短板。借助精准的解码约束,面对从未见过的全新商品,模型的推荐准确率实现了从零到一的突破。

© 版权声明

AI智能体所有文章,如无特殊说明或标注,均为本站作者原创发布。任何个人或组织,在未征得作者同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若此作者内容侵犯了原著者的合法权益,可联系客服处理。

THE END

用户38505528 9个月前0

粘贴不了啊用户12648782 10个月前0

用法杂不对呢?yfarer 10个月前0

草稿id无法下载,是什么问题?