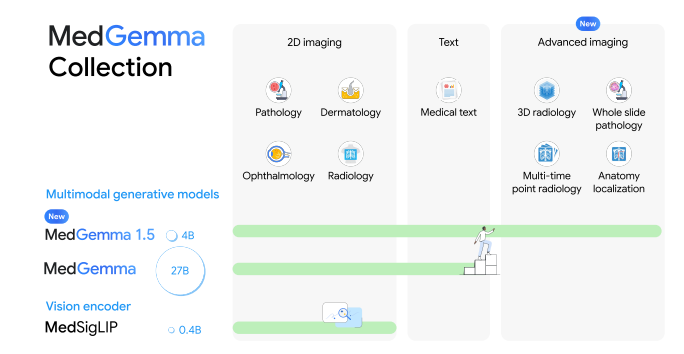

谷歌日前以开源形式发布医疗AI模型MedGemma 1.5。最大的突破在于不再局限于传统2D图像,可处理更高维的医疗数据,在多种关键医疗场景上都有明显进步。

在能力方面,MedGemma 1.5的升级十分全面:原生支持CT、MRI三维扫描,可直接处理包含数十个切片的体积影像;可以解析病理学全视野数字切片,在微观层面寻找病变线索;在胸部X光上,能够用边界框精确标注解剖结构与病灶位置,而不只给出模糊判断;还支持多时间点对比,追踪病情是改善、稳定还是加重。此外,它对PDF格式的电子病历与检验报告的理解显著增强,能更准确地抽取关键结构化信息。

成绩也同样亮眼。相较上一代MedGemma 14B,1.5版本在3D MRI病情分类上的准确率绝对提升11%,全视野病理图像的宏观F1分数提升47%,胸部X光解剖定位的交并比提高35%,电子病历问答准确率上升22%。值得一提的是,这些提升都在参数量仍为40亿的前提下实现,计算效率极高。

在技术上,团队引入了覆盖放射学、皮肤科、病理学以及合成电子健康记录的大规模图文配对数据,并采用预处理方法将3D CT扫描切分为最多85张序列图像;在训练后期,还借助领域专家模型进行知识蒸馏,把专业经验直接“传授”给模型。

需要说明的是,MedGemma 1.5并不等同于开箱即用的临床决策系统。谷歌将其定位为供开发者进一步微调的基础模型,真正用于临床仍需针对具体场景开展专项训练。此外,模型在向“医疗通才”演进的过程中,在一些旧的、小众的视觉问答基准上出现了轻微回落,这是能力全面化过程中常见的权衡。

论文地址:https://www.alphaxiv.org/abs/2604.05081

用户38505528 7个月前0

粘贴不了啊用户12648782 8个月前0

用法杂不对呢?yfarer 8个月前0

草稿id无法下载,是什么问题?