有消息称,开发者

实测要点:选对模型比调优更划算

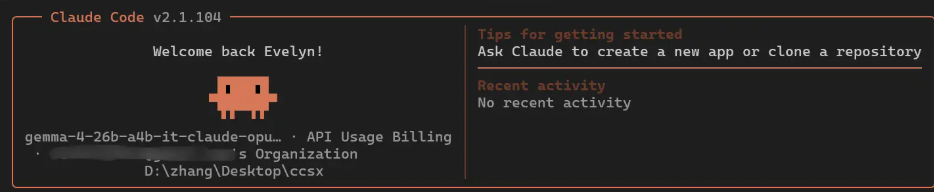

本轮测试中,开发者放弃了体验一般的官方原版,转而使用社区魔改模型

-

极速生成: 生成速率可达 78 tok/s,相比原版只有十几 token/s,差距明显。

-

稀疏激活: 采用 A4B(Active4B)MoE 架构,总参数 26B,但每次推理仅约 4B 参数参与,做到“小算力跑出大模型效果”。

-

超长上下文: 支持 256K 上下文,与 Anthropic API 格式高度兼容,可实现零配置接入。

效能分析:Agentic 工作链一体两面

实测发现,尽管生成本身非常快,但在执行具体任务(如生成教师表相关代码)时,总耗时仍约 1.5 分钟。

-

瓶颈所在: 时间主要消耗在

Claude Code 的多步 Agent 决策链上。系统在动手前会经历多轮 Thought(思考)与 Skill 加载,导致 Prompt Token 激增。 -

权衡取舍: 这类多步决策对代码生成、修改等任务很有价值,能保证流程规范、逻辑闭环;但对于简单问答,更建议直接用

LM Studio 对话,能更省时。

质量评测:JeecgBoot 教师表生成结果

面向

-

规范性: SQL 路径自动遵循 Flyway 规范,日期生成正确。

-

技术栈: 前端采用 Vue3 的 script setup + TS 写法,符合当前主流标准。

-

完整性: 自动产出包含 Controller、Service、Mapper 在内的全套骨架。

-

需要改进: 复杂方法体仍需手工补全,关键业务逻辑建议人工核对。

策略建议:双模型“高低配”协同

基于实测结果,提出一套兼顾隐私、成本与质量的优选方案:

-

本地魔改模型(覆盖 80% 场景): 用于日常 CRUD 生成、代码讲解以及涉隐私的内部项目,零云费且数据不出内网更安心。

-

云端官方 API(覆盖 20% 场景): 处理复杂架构设计、核心安全模块等高难度任务,确保生产级质量与稳定性。

结语:本地化 AI 开发进入新常态

随着

用户38505528 7个月前0

粘贴不了啊用户12648782 8个月前0

用法杂不对呢?yfarer 8个月前0

草稿id无法下载,是什么问题?