在大语言模型(LLM)做推理时,内存常常成为拖慢速度的“罪魁祸首”。一旦 AI 面对长文本或复杂回答,作为“工作内存”的 KV 缓存(Key-Value Cache)会迅速变大,轻则卡顿,重则宕机。为解决这一痛点,谷歌研究院于 2026 年 3 月 26 日正式发布全新的 AI 内存压缩技术 TurboQuant。

这项技术的关键在于:在不影响模型准确性的前提下,把缓存占用压到原来的六分之一,同时推理速度带来最高8倍的提升。

攻破 KV 缓存瓶颈:记得更多,也跑得更快

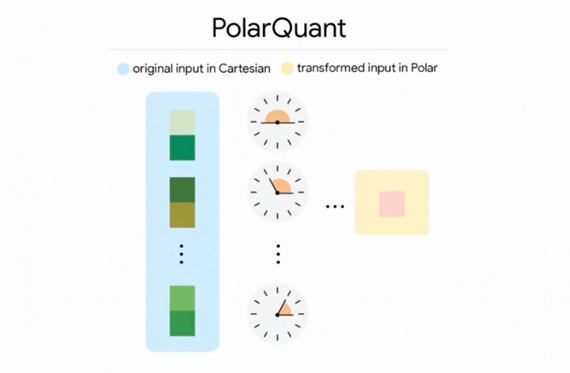

TurboQuant 让 AI 运行效率跨上新台阶。它采用先进的向量量化方案,由 PolarQuant 量化方法配合 QJL 优化组成。面对 Gemma、Mistral 等主流开源大模型的严格测试,TurboQuant 展现出强适配性:无需预训练或微调,就能把键值缓存压缩到 3 比特。在贴近真实业务的“大海捞针”超长上下文评测中,实现了零精度损失,这意味着模型在大幅“瘦身”后,依旧保持原有的理解力与记忆准确度。

硬件表现巅峰:H100 加速器上实现 8 倍提速

除了极大降低内存占用,TurboQuant 在硬件利用率上同样亮眼。在高性能 H100 GPU 加速器上,经过 4 比特优化后的 TurboQuant,相比未量化的 32 比特基线,整体推理速度提升达 8 倍。

这项成果计划在下个月举行的 ICLR 2026 大会上正式发布。对开发者和企业来说,这意味着在相同硬件条件下,可以运行更大规模的模型,或支持更长、更复杂的对话上下文,大幅降低 AI 应用的部署成本与门槛。

© 版权声明

AI智能体所有文章,如无特殊说明或标注,均为本站作者原创发布。任何个人或组织,在未征得作者同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若此作者内容侵犯了原著者的合法权益,可联系客服处理。

THE END

用户38505528 8个月前0

粘贴不了啊用户12648782 9个月前0

用法杂不对呢?yfarer 9个月前0

草稿id无法下载,是什么问题?