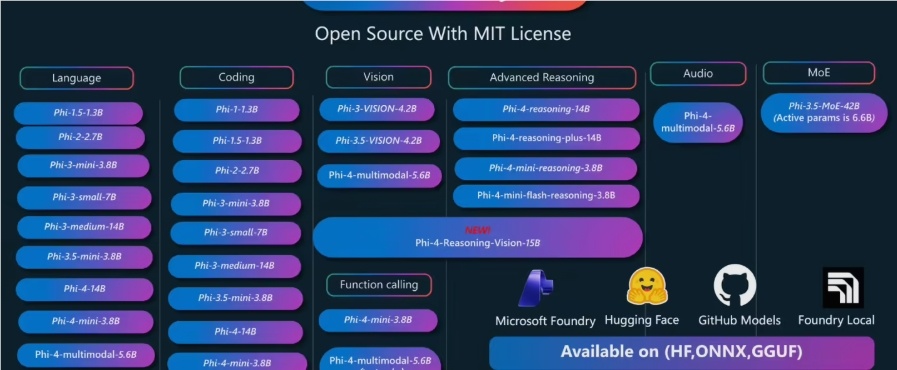

微软近期在开发者社区亮相一款开源小型多模态模型——Phi-4-Reasoning-Vision-15B。该模型同时具备高清视觉理解与强大推理能力,标志着 Phi-4 系列的一次重要跃迁。作为首个兼具“看得清楚”和“想得深入”特性的“小语言模型”(SLM),Phi-4 的问世为开发者开启了更多智能应用的可能。

不同于只做被动识别的传统视觉模型,Phi-4 能将图像内容结构化处理,并开展多步骤推理。它能把图像的视觉结构与文本上下文结合起来,给出可执行的结论。这种能力让从数据图表解读到用户界面自动化等场景都有了更聪明的实现路径。

Phi-4 的一大亮点是灵活的推理模式。当遇到需要深入分析的任务(如数学题或逻辑推演)时,会切换到“推理模式”,执行多步骤思考;而在强调速度的场景(如 OCR 或元素定位)中,则能迅速给出结果,降低延迟。这样的自适应策略大幅提升了模型的实用性和效率。

非推理模式

在智能体应用场景中,Phi-4 的潜力同样突出。只需提供一张屏幕截图和自然语言指令,模型即可输出所需 UI 元素的标准化边界框坐标,其他智能体便能据此完成点击、滚动等交互操作,为用户带来更顺畅的使用体验。

推理模式

总体而言,Phi-4-Reasoning-Vision-15B 不仅在技术维度实现突破,也为智能应用开发提供了扎实支撑。随着该模型开源,期待更多开发者借助其先进能力,创造出更多惊喜的应用场景。

© 版权声明

AI智能体所有文章,如无特殊说明或标注,均为本站作者原创发布。任何个人或组织,在未征得作者同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若此作者内容侵犯了原著者的合法权益,可联系客服处理。

THE END

用户38505528 7个月前0

粘贴不了啊用户12648782 8个月前0

用法杂不对呢?yfarer 8个月前0

草稿id无法下载,是什么问题?