微软刚刚发布全新的开源权重多模态大模型 Phi-4-reasoning-vision-15B。这款模型最大的亮点在于具备“自主决定何时思考”的能力——能根据任务难度自行判断,是直接给出答案,还是进入更深入的逻辑推理。这类能力在当下开源的小体量模型里并不多见。

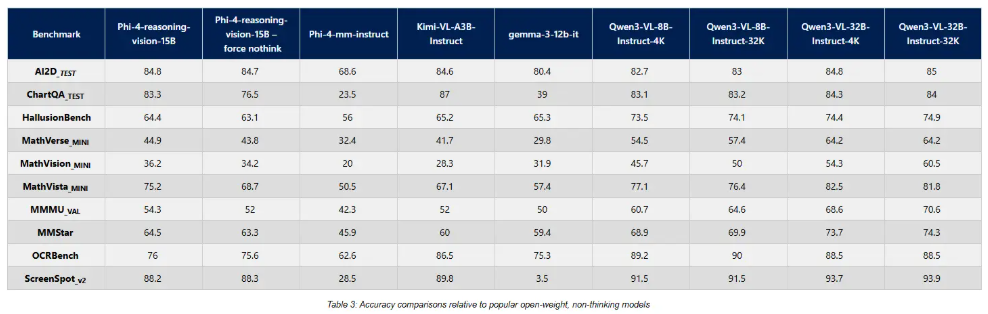

作为 Phi-4 系列的新成员,模型拥有 150 亿参数,并重点强化了图像描述、界面元素定位以及复杂数学推理等高难度场景。微软在架构中加入了“思考模式”的调度机制,避免了传统需要用户手动切换模式的麻烦:简单问题快速回复,遇到复杂任务则自动加深推理过程,从而在响应速度与结果质量之间找到更好的平衡。

在训练策略方面,Phi-415B 走的是“精训而不堆量”的路线。模型仅使用约 2000 亿高质量 Token 完成训练,远低于许多同类模型动辄上万亿的数据规模。微软也借助 GPT-4o 进行辅助训练以提升逻辑准确性,但研发团队表示,真实多样的应用场景中仍需进一步检验与打磨。

目前,微软已在 Hugging Face 与 Microsoft Foundry 等渠道开放了模型权重及相关资源。业内观点认为,尽管开源社区的关注点仍多集中在 Qwen3.5 等模型上,但 Phi-415B 凭借多模态集成与“自适应思考”的特色,对于希望本地部署、追求低成本推理的开发者来说,依然值得关注。

划重点

-

🧠 自适应思考机制: 模型可按任务难度自主决定是否开启深度推理,无需手动切换“思考模式”,兼顾速度与深度。

-

🖼️ 多模态能力增强: 在 15B 参数规模下,于图像理解、界面元素定位和数学逻辑任务中表现突出。

-

📉 高效训练范式: 约 2000 亿高质量 Token 即完成训练,体现微软在数据筛选与模型打磨方面的积累。

用户38505528 7个月前0

粘贴不了啊用户12648782 8个月前0

用法杂不对呢?yfarer 8个月前0

草稿id无法下载,是什么问题?