今天,通义实验室宣布上线两款支持“FreeStyle”指令生成的语音大模型:Fun-CosyVoice3.5与Fun-AudioGen-VD。这一发布让语音生成从依赖预设标签的旧模式,跃迁到可用自然语言自由控制的新体验,实现了“用一句话随心生成语音”的深度互动。

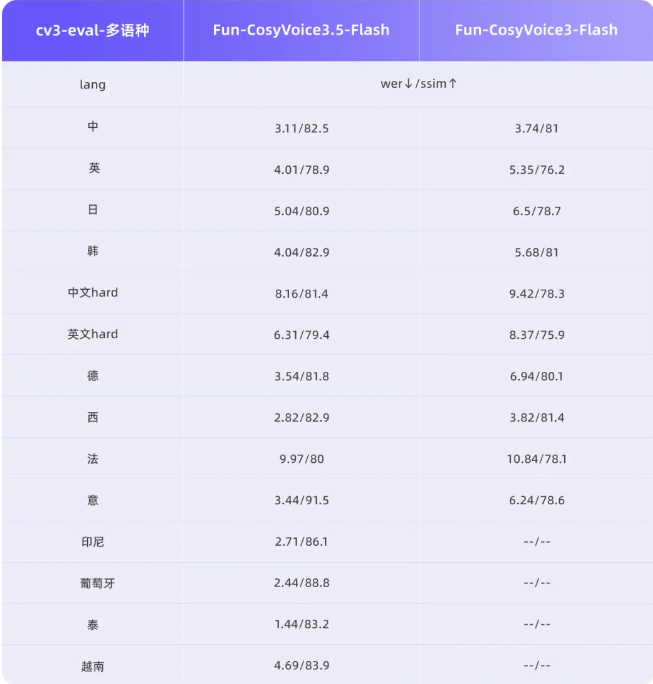

在技术架构与功能升级方面,Fun-CosyVoice3.5主打多语种复刻与细腻表达,新添泰语、印尼语等共4种语言支持。引入DiffRO与GRPO强化学习后,模型在韵律与音质相似度上显著提升;生僻字读错率由15.2%降至5.3%,首包延迟也降低了35%。与之配合的Fun-AudioGen-VD聚焦声音设计与场景化建模,可通过指令精准控制性别、情绪与空间声效,能一体化模拟从“疯狂反派”到“热闹咖啡馆”等复杂角色与背景音的场景。

从行业趋势看,通义实验室的此番动作,正把语音生成从单纯的“转换工具”升级为面向创作的“内容工具”。这类可描述、可编排的数字表达能力,将直接赋能影视、游戏及AI智能体等领域,在降低内容制作成本的同时,大幅丰富人机交互的语义层次。

API调用:https://help.aliyun.com/zh/model-studio/text-to-speech?spm=a2c4g.11186623.help-menu-2400256.d_0_3_2_0.d5536a31V2tEJP

文档:https://help.aliyun.com/zh/model-studio/cosyvoice-clone-api?spm=a2c4g.11186623.help-menu-search-2400256.d_2

用户38505528 9个月前0

粘贴不了啊用户12648782 10个月前0

用法杂不对呢?yfarer 10个月前0

草稿id无法下载,是什么问题?