近日,小红书与复旦大学联合推出了布局可控生成(Layout-to-Image)方向的最新成果——InstanceAssemble。该技术专注解决 AI 绘画长期存在的“构图难题”,通过创新机制让从简单到复杂场景都能精准生成。据悉,相关论文已被人工智能顶级会议 NeurIPS2025收录。

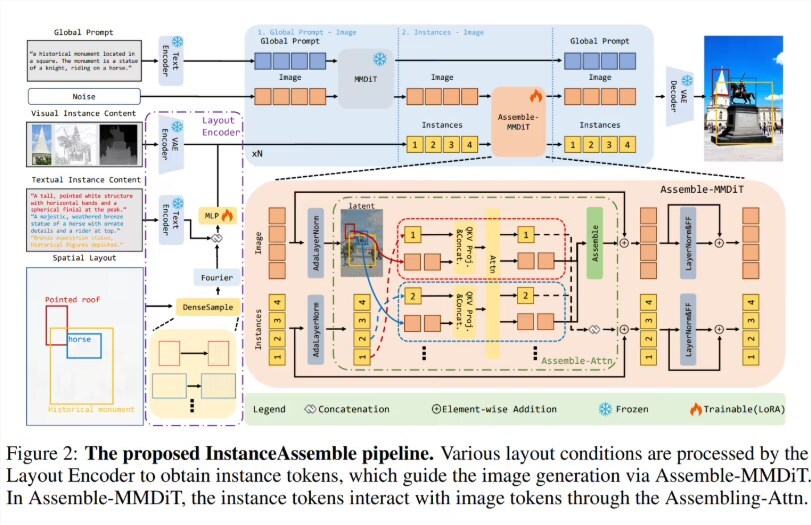

在当下的 AI 绘画中,虽然“文生图”已相对成熟,但在“布局可控生成”方面,模型常难以严格遵守用户给出的空间约束(如边界框或分割掩码),容易出现位置不准或语义不一致。InstanceAssemble 的到来,意味着 AI 绘画迈入“精准构图”的新阶段。该方法基于主流扩散变换器架构,其核心创新是“实例拼装注意力”机制。

用户只需为每个目标提供具体位置(边界框)与内容描述,模型即可在指定区域内生成符合要求的图像内容。无论是仅有少量物体的简洁画面,还是实例密集的复杂场景,InstanceAssemble 都能保持极高的排版精度与语义一致性。

更值得一提的是,InstanceAssemble 采用轻量化适配方案。无需对整套大模型重新训练,只需极少的额外参数即可接入现有模型。例如,适配 Stable Diffusion3-Medium 约需 3.46% 的额外参数;适配 Flux.1 时,参数占比更是低至 0.84%。

为全面评估技术效果,研究团队同步发布了包含约 9 万个实例的“Denselayout”基准测试集及全新评估指标。目前,

github:https://github.com/FireRedTeam/InstanceAssemble

划重点:

-

🎯 精准排版控制: 依托“实例拼装注意力”机制,让模型严格按照用户设定的位置生成物体,覆盖从稀疏到高密度的复杂布局。

-

⚡ 极低适配成本: 轻量化接入,无需重训全模型,仅需约 0.84% 至 4% 的额外参数即可适配 Flux.1 或 SD3 等主流模型。

-

🔓 全面开源共享: 项目已在 GitHub 开源并提供预训练模型,同时发布 Denselayout 测试基准与新评估指标,推动行业标准化。

用户38505528 8个月前0

粘贴不了啊用户12648782 9个月前0

用法杂不对呢?yfarer 9个月前0

草稿id无法下载,是什么问题?