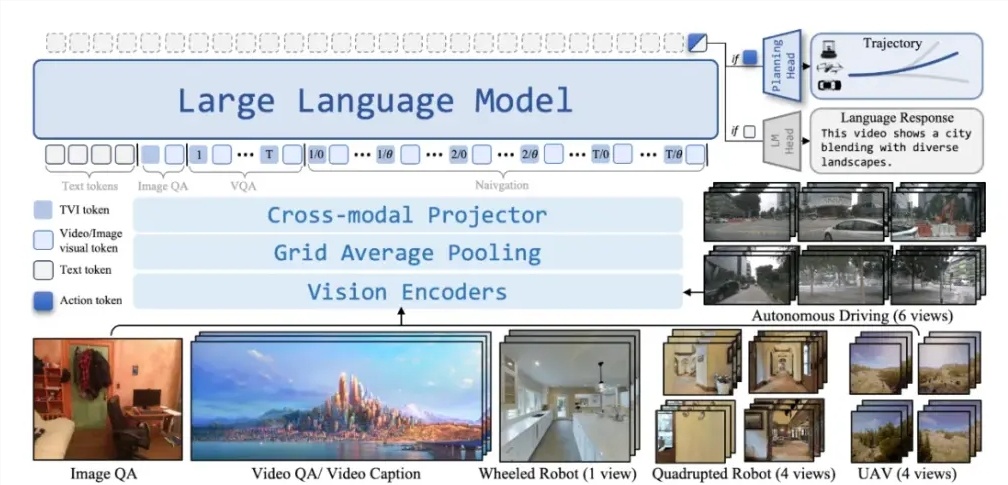

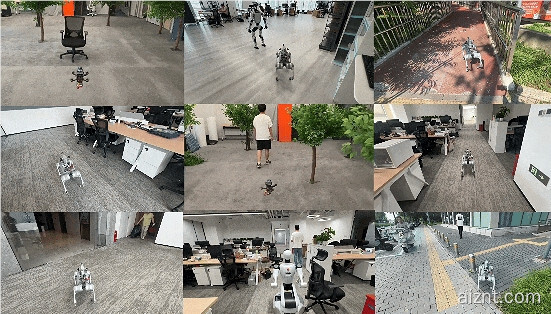

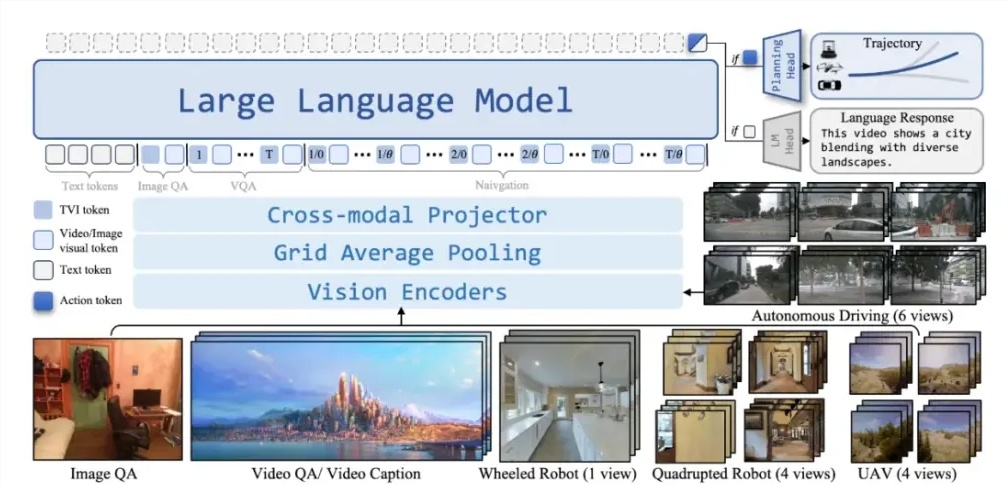

近日,银河通用联合北京大学、阿德莱德大学与浙江大学等团队,发布了全球首个支持跨本体、全域环视的导航基座大模型 —— NavFoM(Navigation Foundation Model)。这一模型旨在把不同类型的机器人导航任务纳入同一套统一框架,覆盖视觉与语言导航、目标导向导航、视觉追踪以及自主驾驶等多种应用场景。

NavFoM 的一大亮点是全场景适配能力:不论室内还是室外,即便是从未见过的新环境,也能实现零样本运行,无需额外建图或数据采集。这让用户在部署时更省心,无需繁琐的前期准备。

同时,NavFoM 支持多任务协作,可通过自然语言指令完成目标跟随、自主导航等功能。由于架构通用性强,从机器狗、无人机,到轮式/人形平台、汽车等不同尺寸与形态的机器人,都能在该框架下快捷接入并高效运转。

在技术层面,NavFoM 带来了两项关键创新:其一是 TVI Tokens(Temporal-Viewpoint-Indexed Tokens),让模型具备对时间与朝向的理解;其二是 BATS 策略(Budget-Aware Token Sampling),使模型在算力受限的条件下仍能保持优异表现。

值得注意的是,NavFoM 构建了规模庞大的跨任务数据集,包含约八百万条跨任务、跨本体的导航数据,并额外汇集了四百万条开放问答数据。整体训练量约为以往工作的两倍,显著增强了模型在语言与空间语义方面的理解能力。

NavFoM 的问世标志着机器人导航领域迈出重要一步。开发者可以以此为基座,通过后续训练与适配,持续拓展并打磨符合具体需求的应用模型。

划重点:

🌟 NavFoM 是全球首个支持跨本体、全域环视的导航大模型,可将多类机器人导航任务统一到一套框架中。

🏞️ 室内外均可零样本运行,无需额外建图与数据采集,部署更便捷。

💡 引入 TVI Tokens 与 BATS 策略,强化时间与方向理解,并在算力受限时依旧表现出色。

用户38505528 1个月前0

粘贴不了啊用户12648782 2个月前0

用法杂不对呢?yfarer 2个月前0

草稿id无法下载,是什么问题?