英伟达(NVIDIA)近日在通用人工智能(AGI)方向迎来全新进展,发布一款名为

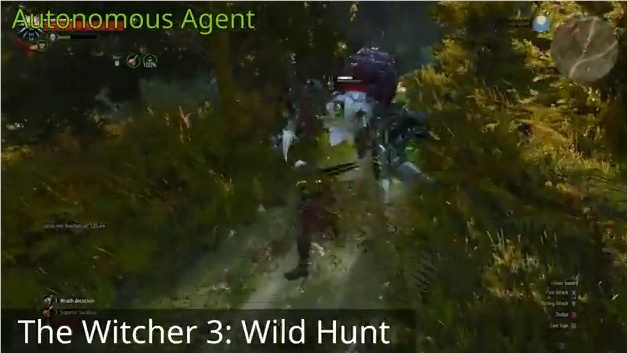

为让 NitroGen 掌握复杂的操作思路,研究团队挖掘了一个此前较少被系统利用的“宝库”:YouTube 与 Twitch 上带控制器叠加层的游戏实况视频。通过学习覆盖1000多款游戏、累计超过4万小时的玩家录屏,NitroGen 学会了如何依据视觉反馈直接生成操作指令。研究人员借助模板匹配与经微调的 SegFormer 模型,从海量视频中精准还原玩家的实时按键输入。

在架构层面,NitroGen 深度融合了英伟达此前发布的

目前,由英伟达、斯坦福与加州理工学院等一流学术机构组成的联合团队,已将该项目的

划重点:

-

🎮 数据规模驱动: 基于 YouTube 与 Twitch 超过 4 万小时的游戏视频训练,通过识别画面中的手柄叠层按键,学习人类玩家的操作逻辑。

-

🚀 通用性出众: 作为通用智能体,NitroGen 在陌生游戏任务中的成功率较传统从零训练模型提升 52%。

-

🔓 开放共享: 团队已公开模型权重、代码与数据集,为通用 AI 智能体的发展奠定关键基础。

如果你想进一步了解 NitroGen 的技术细节,我可以详细讲讲它如何从视频中恢复和提取操作指令,要不要继续看下去?

用户38505528 8个月前0

粘贴不了啊用户12648782 9个月前0

用法杂不对呢?yfarer 9个月前0

草稿id无法下载,是什么问题?