12月9日消息,阿里巴巴 Qwen 团队发布了新一代全模态大模型 Qwen3-Omni-Flash-2025-12-01。该模型支持文本、图片、音频和视频的无缝输入,并能以实时流式方式同步输出高质量文字与自然语音。官方表示,其语音自然度已接近真人。

技术亮点:实时流式全模态交互

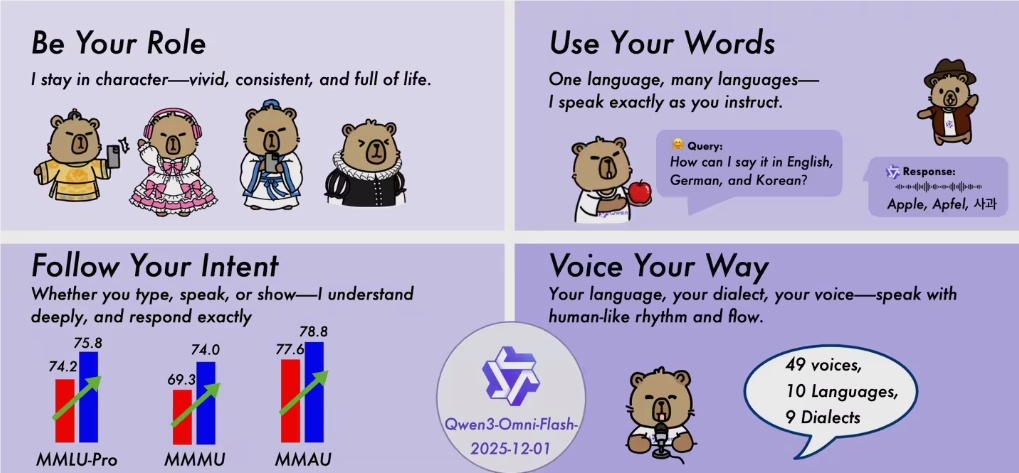

Qwen3-Omni-Flash 采用实时流式架构,可实现文本、图像、音频和视频的无缝输入与同步输出。模型支持 119 种文本语言交互、19 种语音识别语言以及 10 种语音合成语言,确保跨语言场景下的准确响应。

个性化体验:System Prompt 全面开放自定义

新版本开放 System Prompt 的自定义权限,用户可细致调控模型行为,包括设定「甜妹」「御姐」等特定人设风格,并可调整口语化偏好与回复长度。模型还会根据文本内容自适应调节语速、停顿与韵律。

性能提升:基准测试全面升级

官方数据显示,新模型在逻辑推理任务(ZebraLogic)上提升 5.6,在代码生成(LiveCodeBench-v6)上提升 9.3,在多学科视觉问答(MMMU)上提升 4.7,展现出更强的多模态理解与分析能力。

落地与价格:API 已开放,定价友好

Qwen3-Omni-Flash 现已通过 API 上线,输入定价为 1 元/百万 tokens,输出为 3 元/百万 tokens。模型已在 Qwen Chat 集成 Demo,支持上传 30 秒视频并实时生成带画面口播。

行业意义:全模态迈入「人格化」阶段

当多模态还在比拼能看懂多少图时,阿里把「实时流 + 人格化」直接做成了 API。对直播、短视频、虚拟会议等重语音、重风格的场景而言,这几乎将「配音演员 + 后期口播」的成本降到接近零。

下一步计划:

2025 年 Q1 将发布 70B 轻量版,单卡 A100 可跑实时流;Q2 开放「语音克隆 10 秒」接口;Q3 上线「视频驱动头像」Beta 功能。后续将持续关注其语音克隆与视频驱动头像功能的开放进度。

用户38505528 8个月前0

粘贴不了啊用户12648782 9个月前0

用法杂不对呢?yfarer 9个月前0

草稿id无法下载,是什么问题?