阿里巴巴通义实验室今天正式开源 Z-Image-Turbo-Fun-Controlnet-Union。这款全新的 ControlNet 模型,意味着 Z-Image 系列在图像生成生态上的一次重要升级。作为业内 独家追踪的开源 AI 动向,此次发布进一步夯实了 Z-Image-Turbo 在精准控制与创意生成方面的领先优势,迅速引发全球开发者与创作者讨论。

模型已在 Hugging Face 平台上线,采用 Apache-2.0 许可,可直接用于商业。发布背景与技术基础Z-Image 系列自11月底首发以来,迅速登顶 Hugging Face 趋势榜,首日下载量突破50万。

该系列以单流扩散架构为核心,仅6亿参数就能实现照片级真实渲染,皮肤纹理、发丝细节和光影表现都很到位。Z-Image-Turbo 是加速推理版本,8步采样即可生成1024×1024分辨率图片,在RTX4080上推理约9秒;同时支持中英文混合提示词,更好理解意图,提升创作效率。

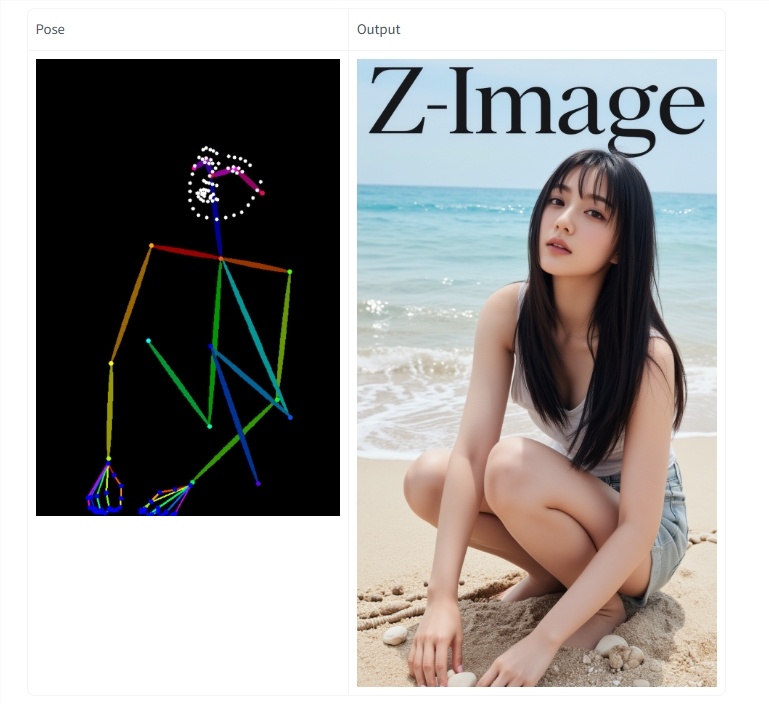

这次推出的 Z-Image-Turbo-Fun-Controlnet-Union,是对 Z-Image-Turbo 的深度扩展。模型在6个核心模块中融入了 ControlNet 结构,兼容 Canny 边缘、HED 轮廓和 Depth 深度等多种控制条件。它面向复杂场景,比如精准的人体姿态生成、基于线稿的建筑渲染;目前已提供 Python 集成代码,ComfyUI 等工作流支持将很快到来。

核心功能与应用亮点

- 多条件控制融合: 同时接入姿态、边缘和深度信息,实现几乎“零失真”的图像操控。开发者可快速搭建从草图到成品的自动化流程,适合电商视觉、影视特效、游戏原型等。

- 高效兼容性: 延续 Z-Image-Turbo 的轻量架构,约6GB显存即可运行,硬件门槛远低于传统 ControlNet。实测在低端GPU上,5步生成约250秒,兼顾画质与速度。

- 开源生态赋能: 提供4-bit量化版本(兼容 MFLUX),方便在 Mac 等消费级设备部署。同时,Z-Image-Edit 变体强化了多指令编辑理解,画面一致性更稳定。

这些能力既降低了 AI 图像生成的门槛,也让非专业用户能做出专业级作品。社区反馈显示,在广告素材生成场景中,该模型的提示词执行准确度优于 OVIS Image 等同类。

社区反响与未来展望开源社区反应热烈。Reddit 和 X 上已出现大量测试,包括名人面孔识别和 K-pop 偶像生成等实验,结果显示它在辨识度与自然度上表现突出。不少开发者称其“对着 Flux 打”效率更高,尤其在低 CFG Scale(2-3)下输出更稳定。业内分析认为,这次发布进一步提升了阿里巴巴在开源 AI 领域的全球竞争力。

未来,官方预计会与 Z-Image-Base 联动,形成“生成—编辑—控制”的完整闭环。

Hugging Face :https://huggingface.co/alibaba-pai/Z-Image-Turbo-Fun-Controlnet-Union

用户38505528 8个月前0

粘贴不了啊用户12648782 9个月前0

用法杂不对呢?yfarer 9个月前0

草稿id无法下载,是什么问题?