当地时间4月28日,英伟达正式推出其最新的开放式多模态大模型——Nemotron3Nano Omni。该模型被定位为“全能型”,将视频、音频、图像和文本的深度推理能力融为一体,旨在为开发者带来更快、更智能的交互体验。

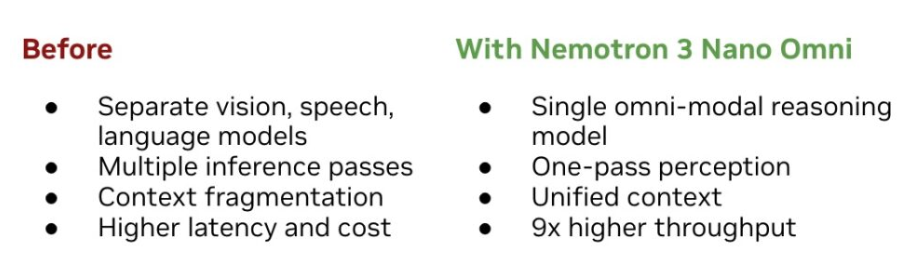

技术架构方面的升级是此次发布的一大看点。Nemotron3Nano Omni采用30B-A3B的“混合专家”(MoE)设计,把视觉与音频编码器直接内置到系统中。这样的集成方式打破了以往多模态处理需要依赖多个独立感知模型的局面,实现了从“碎片化上下文”向“统一上下文”的跃迁。

性能表现同样抢眼。按照官方信息,该模型在复杂文档处理、视频理解与音频感知等六大权威榜单中均位居前列。凭借更高的感知精度,在保持极高交互性的同时,其吞吐量达到同类开放式全向模型的9倍。这意味着企业在部署AI智能体时,可以用更低的成本获得更强的扩展能力,并且不牺牲响应的及时性。

目前,多家前沿科技企业已开始接入。H Company首席执行官Gautier Cloix表示,受益于新架构,他们的AI代理现在可以实时解读全高清屏幕录制,这标志着AI正从简单的任务执行者,走向能够实时感知并理解数字环境的互动者。

作为Nemotron3系列(包含Nano、Super和Ultra型号)的重要成员,该系列在过去一年累计下载量已超过5000万次。英伟达表示,Nemotron3Nano Omni既可独立运行,也能与专有云模型或其他开源模型协同,为复杂的代理工作流提供底座支持。本次发布无疑为企业级AI智能体的生产与部署树立了全新的效率标杆。

© 版权声明

AI智能体所有文章,如无特殊说明或标注,均为本站作者原创发布。任何个人或组织,在未征得作者同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若此作者内容侵犯了原著者的合法权益,可联系客服处理。

THE END

用户38505528 7个月前0

粘贴不了啊用户12648782 8个月前0

用法杂不对呢?yfarer 8个月前0

草稿id无法下载,是什么问题?