近日,腾讯 Robotics X 实验室与混元团队联合发布并开源了 HY-Embodied-0.5-X,这是一款为具身任务深度优化的多模态大模型,旨在增强机器人在真实场景中的智能交互能力。该模型基于 HY-Embodied-0.5-MoT-2B 架构,突出机器人“看懂、想清、做到”的核心能力,尤其在精细操作、空间理解、动作预测及风险评估等方面有出色表现。

HY-Embodied-0.5 系列包含两个主要版本:MoT-2B 与 MoE-32B。MoT-2B 面向端侧部署,响应更及时;MoE-32B 规模更大,适合处理更复杂的任务。HY-Embodied-0.5-X 着重面向真实交互应用,推动能力从“看懂”走向“能干”,为家庭服务与桌面操作等实际场景提供强力支撑。

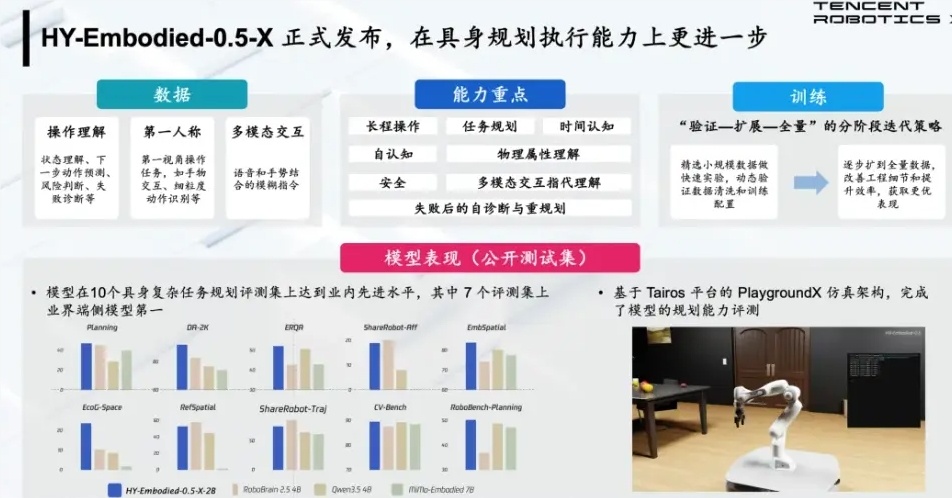

在数据层面,HY-Embodied-0.5-X 融合自采的机器人第一视角操作数据与开源具身数据,构建高质量训练集。该数据集不仅覆盖操作理解与任务推理,也强化了模型对模糊指令的理解能力。此外,团队引入思维链标注与数据质量闭环机制,确保训练有效、数据可靠。

在训练策略上,HY-Embodied-0.5-X 采用分阶段迭代方式:先用小规模高质量数据验证配置,再逐步扩展至大规模训练,以提升效率与稳定性。模型在空间理解、长程规划与具身交互方面展现明显优势,使机器人能更准确理解环境并完成复杂任务。

HY-Embodied-0.5-X 的发布标志着腾讯在具身智能领域的又一步关键进展,有望在人与机器人的互动中,推动技术的进一步落地与应用。

划重点:

🌟 HY-Embodied-0.5-X 是面向机器人智能交互优化的新款多模态大模型。

🤖 结合多源数据,显著增强机器人在真实环境中的操作理解与执行能力。

🔄 分阶段训练策略保障高效稳定,适配家庭与桌面等多种应用场景。

用户38505528 7个月前0

粘贴不了啊用户12648782 8个月前0

用法杂不对呢?yfarer 8个月前0

草稿id无法下载,是什么问题?