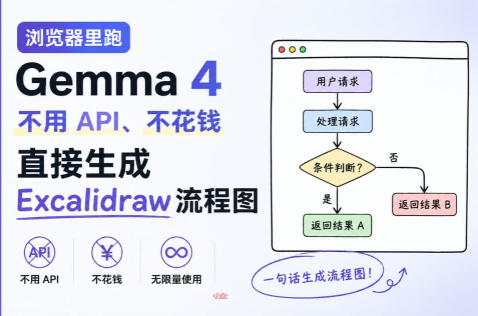

在手机上跑大模型已经见怪不怪,而让浏览器也拥有强劲的 AI 算力,正逐步成为新趋势。最近,有开发者把 Google 最新 的 TurboQuant 算法用起来,把 Gemma4 模型直接搬进了浏览器。这意味着你无需折腾复杂的 API 配置,也不用付订阅费,就能在本地环境流畅使用 AI。

核心技术:TurboQuant 带来的记忆升级

此次突破的关键在于 Google 提出的 TurboQuant。它把大模型的“临时记忆库”——KV Cache(键值缓存)做了深度优化。

传统方案里,只要对话够长或任务够复杂,缓存就会越来越大,进而拖慢系统。而 TurboQuant 能把这类向量压缩到原来的六分之一,还能在不解压的情况下直接检索。凭借这项“压着就能搜”的能力,模型既能保持更长的上下文记忆,又能显著提升效率。

实测体验:三十秒生成专业流程图

以集成该方案的本地绘图工具为例,用户只需在支持 WebGPU 的 Chrome 134+ 桌面浏览器中打开页面,即可直接调用 Gemma4E2B 模型。

实测中,生成一张结构清晰的 Excalidraw 流程图大约用时 32.9 秒。数据表现为浏览器内推理速度约每秒 24 个 token,端到端响应利落。更大的优势在于,整个计算都在你的设备本地完成,不消耗任何在线 Token,真正实现“创作零成本”。

门槛与展望:本地化 AI 应用的新形态

虽然做到了“流量自由”,但本地运行仍有一定硬件门槛。用户首次使用需要下载约 3.1GB 的模型文件,且需满足指定的浏览器版本。

基于 WASM(WebAssembly)和 TurboQuant 的这套路径,为轻量 AI 应用提供了可借鉴的样板。它证明了不依赖昂贵云算力,只靠算法优化,浏览器也能胜任复杂的流程图绘制和长文本处理。对于看重隐私与成本的用户来说,这种“打开即用、全程本地”的模式,极有可能成为未来 AI 工具的主流选择。

用户38505528 7个月前0

粘贴不了啊用户12648782 8个月前0

用法杂不对呢?yfarer 8个月前0

草稿id无法下载,是什么问题?