国产大模型头部厂商 DeepSeek 日前发布重磅降价,将全系 API 的输入缓存命中费用压至首发价的1/10。这一动作意味着本土 AI 的成本控制迈入新阶段,力图以极致性价比吸引更多开发者与企业接入。

核心降幅直指行业痛点

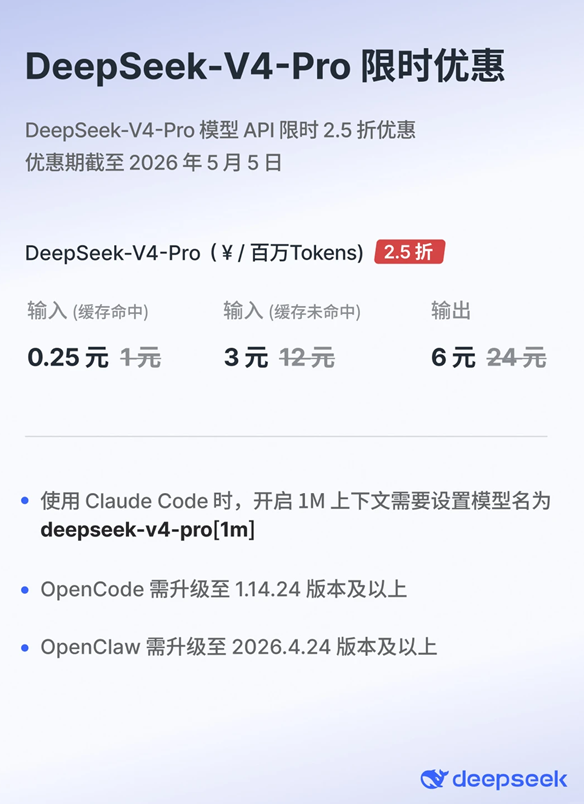

此次降价覆盖 V4-Pro 与 V4-Flash 全线产品。其中,V4-Pro 的缓存输入费降到0.1元/百万 Tokens,叠加限时优惠后到手价仅需0.025元。对比海外竞品,该缓存输入定价约为 GPT-5.5Pro 的1/700,显示出极强的市场竞争力。

除缓存命中外,未命中场景与输出费用也同步降至原价的1/4。此定价策略重点覆盖 RAG 知识库、智能客服与文档分析等高频调用,用以帮助企业将运营成本最高压缩超过90%。

DeepSeek 之所以能够实现这轮大幅降价,得益于其自研的稀疏注意力架构。该技术支持 160k 超长上下文,在提升长文本处理效率的同时,明显降低底层算力消耗与存储成本。

目前,DeepSeek 已与华为云、阿里云等八大主流云平台深度适配。业内普遍认为,此举有望重塑大模型行业的定价体系,倒逼海外模型调整策略,加速 AI 应用从实验室走向大规模商业普惠。

© 版权声明

AI智能体所有文章,如无特殊说明或标注,均为本站作者原创发布。任何个人或组织,在未征得作者同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若此作者内容侵犯了原著者的合法权益,可联系客服处理。

THE END

用户38505528 7个月前0

粘贴不了啊用户12648782 8个月前0

用法杂不对呢?yfarer 8个月前0

草稿id无法下载,是什么问题?