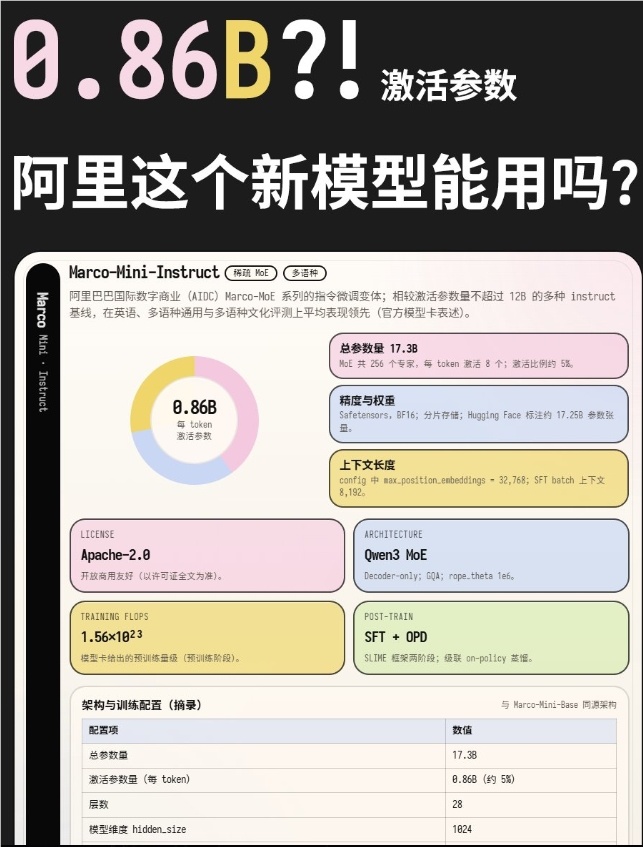

阿里国际数字商业团队近日为 Marco-MoE 系列带来全新成员——Marco-Mini-Instruct,再次诠释“以小胜大”的极简高效理念。该模型总参数 17.3B,但实际激活仅 0.86B(约 5%),推理效率超高,在普通 CPU 上也能流畅运行。

轻量到位:CPU 也能跑飞起

按官方测算,如果采用 8bit 量化并搭配 4 条 DDR4 2400 内存,推理速度可达约 30 token/s。这一表现让 MoE 架构真正迈向“人人可用”,显著降低本地部署门槛。

核心创新:Upcycling 技术“点石成金”

Marco-Mini-Instruct 的最突出的亮点不在于规模或速度,而是它的诞生方式。该模型并非从零开始训练,而是基于 Qwen3-0.6B-Base 通过 upcycling 技术转化为 MoE。

具体做法是:将 Dense 小模型的部分模块拆分或复制为多个专家(experts),并引入路由机制;同时结合细粒度子矩阵切分与Drop-Upcycling策略(训练中按一定概率随机丢弃部分专家或路由路径,并配合正则化以增强稳健性),实现从纯 Dense 到 MoE 的平滑过渡。这为行业提供了一条低成本、高效率的 MoE“炼制”新路径。

上下文与训练配置细节

模型 config 中的 max_position_embeddings 扩展至 32K,但在 SFT 阶段实际使用的是 8192 token 上下文,因此默认上下文长度已能满足多数实际应用场景。

后训练亮点:级联 On-Policy 蒸馏

后训练流程同样亮眼:先进行 SFT 预热,随后采用级联 On-Policy Distillation策略——先以 Qwen3-30B-A3B-Instruct 作为教师模型进行蒸馏,再切换到更强的 Qwen3-Next-80B-A3B-Instruct。蒸馏数据覆盖指令遵循、复杂推理、安全对齐、数学能力等多个维度,在保证高效的同时全面提升综合智能。

性能实测:0.86B 激活对比 4B 级 Dense 模型占优

最终发布的 Marco-Mini-Instruct 在多数主流基准上,仅凭 0.86B 激活参数,就超越了 Qwen3-4B 等多款 Dense 模型,充分证明了“小而美”的 MoE 路线潜力。

行业意义:开源 MoE 炼制新范式

业内观点认为,这一成果的价值在于打开了新入口——无需从零训练海量 MoE,只需选取合适的 Dense 小模型,严格复现实验中的 upcycling + Drop-Upcycling 流程即可。整体训练成本可控:SFT 阶段约 64 GPU × 24 小时,蒸馏阶段约 64 GPU × 110 小时,显著降低中小团队尝试 MoE 的门槛。

此次“魔改”再次说明:效率突破不必靠堆参数,创新的训练范式同样能带来质变。Marco-Mini-Instruct 的发布,有望加速 MoE 技术在边缘设备与个人开发者场景的落地,值得全行业持续关注。

用户38505528 8个月前0

粘贴不了啊用户12648782 9个月前0

用法杂不对呢?yfarer 9个月前0

草稿id无法下载,是什么问题?