3月31日,蚂蚁灵波科技宣布开放大规模 RGB-D 深度数据集 LingBot-Depth-Dataset。该数据集共收录300万对高质量样本,其中200万对来自真实场景采集,另有100万对由渲染生成,总体容量达 2.71TB,覆盖6款主流深度相机,是当前开源社区真实场景 RGB-D 数据集中体量最大的一套。此次开放为具身智能、空间感知与三维视觉等方向提供了更丰富、更贴近实际应用的数据基础。

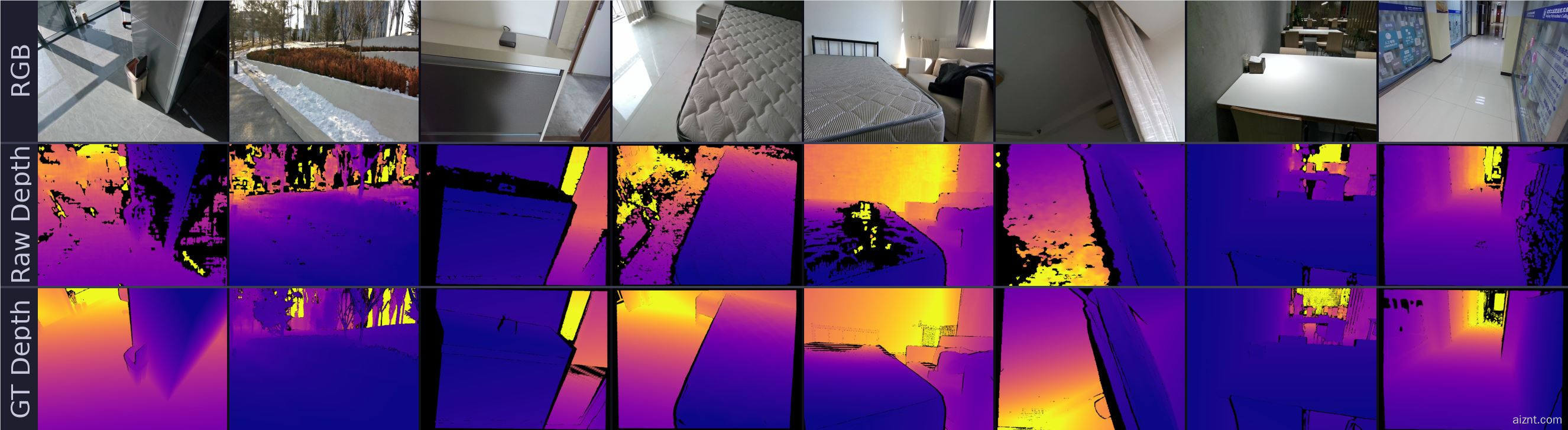

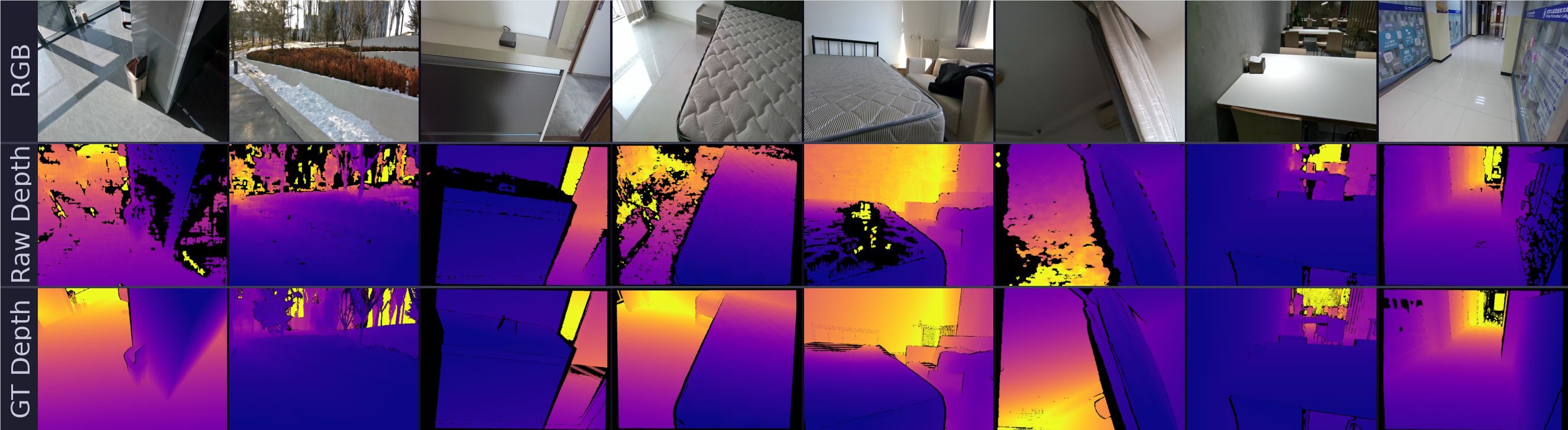

(图注:LingBot-Depth-Dataset 数据示例。从上到下依次为 RGB 图像、传感器输出的原始深度图和真值深度图。数据集同时提供原始深度与真值深度信息,为模型在真实场景中的训练与评估提供有力支撑。)

一直以来,公开的深度数据集普遍存在规模不足、真实场景覆盖不够、硬件设备类型单一等问题。许多数据以合成为主,与真实传感器在噪声、空洞和材质表现等方面差异明显,限制了相关模型在实际环境中的落地效果。

LingBot-Depth-Dataset 针对上述痛点进行了补足,尤其是提供了大规模、基于真实拍摄的样本。每条数据都包含 RGB 图像、传感器原始深度图和真值深度图,可直接用于深度估计与深度补全任务的训练和评测。数据集覆盖 Orbbec335、335L,以及 Intel RealSense D405、D415、D435、D455 共6款主流深度相机,有助于提升模型在不同设备与场景下的训练、适配与评估能力。

据介绍,蚂蚁灵波此前开源的高精度空间感知模型 LingBot-Depth,以该数据集为核心训练数据。与业界主流方法 PromptDA 和 PriorDA 相比,LingBot-Depth 在室内场景中的深度预测误差降幅超过 70%,在稀疏深度补全等任务中的误差约降 47%。将该模型部署到市售深度相机后,无需升级硬件,即可在透明玻璃、镜面反光、逆光等复杂场景下输出更完整、更平滑、边缘更清晰的深度图,且在部分场景中的表现可超越业界顶级工业级深度相机。

对于高校与科研机构而言,此次开源不仅能降低数据采集与标注门槛,也有望加速相关技术从实验验证走向真实应用。随着机器人与具身智能加速落地,大规模、高质量、以真实采集为主的空间感知数据集,将成为行业持续进步的重要基础设施。

用户38505528 8个月前0

粘贴不了啊用户12648782 9个月前0

用法杂不对呢?yfarer 9个月前0

草稿id无法下载,是什么问题?