谷歌宣布在全球超过200个国家和地区正式上线“Search Live”。这次更新意味着移动搜索正从以文字/图片为主的传统检索,走向实时、可对话的多模态交互。用户现在可在Android与iOS端的Google应用或Google Lens中,通过手机摄像头配合语音指令,与现实环境进行实时AI交流。

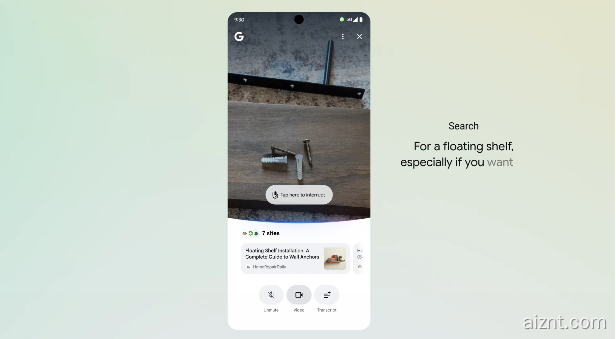

Search Live的核心由全新的Gemini3.1Flash Live模型驱动。作为原生多语言的音频/语音大模型,它带来了更自然的交流体验和更快的响应。在实际使用中,用户只需把摄像头对准目标并发问,比如复杂的家具安装步骤或动植物识别,系统即可同步给出口播答案与相关网页链接,让现实物品与在线信息无缝衔接。

业内将此视作谷歌应对AI搜索竞争的关键动作。当前,Luma AI发布的Uni-1等模型正试图在图像处理上与谷歌竞争,OpenAI也计划把ChatGPT与浏览器能力整合,打造超级应用。谷歌通过全球化部署Search Live,借助Gemini3.1Flash Live的轻量与高响应特性,进一步巩固其在移动端入口的优势与护城河。

这一功能的全面铺开,意味着AI助手正从“被动检索工具”走向“主动感知伙伴”。通过深度融合计算机视觉与实时语音处理,谷歌正在拓展信息获取的边界,推动搜索迈入空间智能与多模态交互的新阶段。

© 版权声明

AI智能体所有文章,如无特殊说明或标注,均为本站作者原创发布。任何个人或组织,在未征得作者同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若此作者内容侵犯了原著者的合法权益,可联系客服处理。

THE END

用户38505528 8个月前0

粘贴不了啊用户12648782 9个月前0

用法杂不对呢?yfarer 9个月前0

草稿id无法下载,是什么问题?