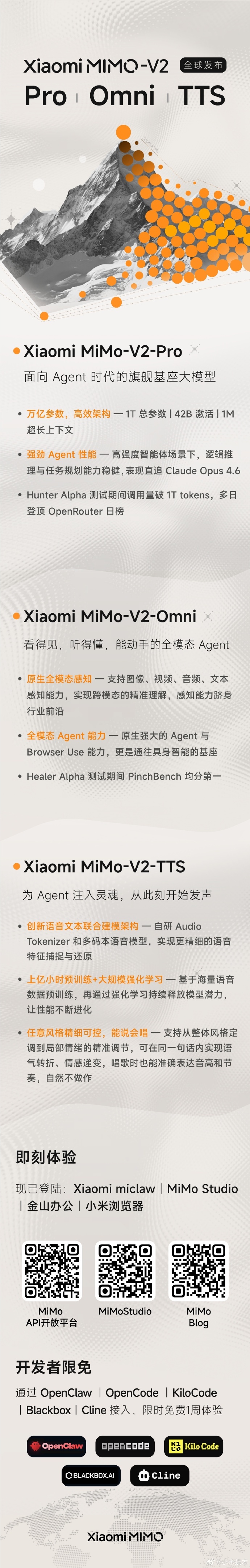

小米官宣推出自研语音合成大模型 Xiaomi MiMo-V2-TTS,意味着其在可控性强、表现力突出的语音生成方向取得里程碑式进展。该模型基于自研 Audio Tokenizer 与多码本的语音-文本联合建模框架,

依托上亿小时语音的大规模预训练,实现了从整体风格把握到细微情绪变化的精准调控。不同于传统 TTS,MiMo-V2-TTS 可在同一句话中完成语气转折与情感递进,逼真还原人类说话的自然节奏与韵律,并可生成音高与节奏更准确的歌声。在技术实现上,小米引入多维度强化学习,兼顾生成稳定性与表现力。模型能够自动识别标点、语气词与强调标记等文本信号,无需额外人工标注即可转化为恰当的语音呈现。此外,模型具备出色的跨地域适配能力,支持包括东北话、四川话、河南话、粤语及台湾腔等多种方言,并可进行角色化演绎。

作为小米语音技术路线的重要里程碑,MiMo-V2-TTS 未来将继续拓展多语种覆盖,并与 MiMo-V2-Omni 的多模态理解能力深度协同。从单一语音合成进化为多模态感知与表达的协同,将推动 AI 智能体(Agent)从纯语义交互走向更具人格与情感共鸣的人机沟通,显著提升智能座舱与智能家居等场景的体验。

© 版权声明

AI智能体所有文章,如无特殊说明或标注,均为本站作者原创发布。任何个人或组织,在未征得作者同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若此作者内容侵犯了原著者的合法权益,可联系客服处理。

THE END

用户38505528 8个月前0

粘贴不了啊用户12648782 9个月前0

用法杂不对呢?yfarer 9个月前0

草稿id无法下载,是什么问题?