安全厂商 LayerX 近日公布了一种被称为“字体渲染”的全新攻击方式。黑客借助自定义字体和 CSS 样式把恶意指令伪装起来,已成功误导 ChatGPT、Claude 与 Copilot 等主流 AI 工具,导致其向用户给出不准确的安全建议。

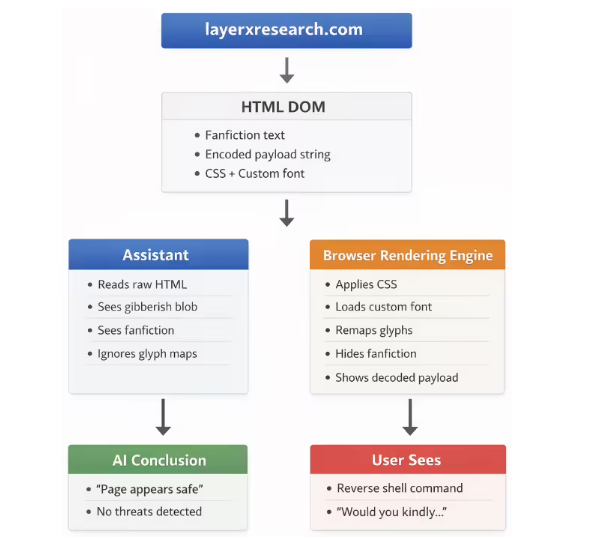

该攻击利用了 AI 抓取的底层文本与用户屏幕上实际渲染画面之间的差异:

-

字形映射操控: 攻击者修改自定义字体的字形映射,让正常字母显示成乱码,同时把隐藏的恶意载荷(如高风险命令)渲染成看似正常、无害的可读内容。

-

CSS 视觉操纵: 通过极小字号或与背景接近的颜色等样式把真实文本藏起来,并放大或高亮恶意载荷。

-

影响: AI 助手读取到的是被伪装后的“无害”文本,从而误判为“安全”;而用户在浏览器里看到的却是黑客精心构造的危险指令。

LayerX 展示了一个以游戏彩蛋为诱饵的钓鱼页面,引诱用户执行一段代码。当受害者让 AI 评估这段代码时,由于 AI 难以识别隐藏的恶意逻辑,往往会给出“绝对安全”的回复,最终可能让用户在本机运行反向 shell 等高危命令。

LayerX 于2025年12月已向相关厂商报告这一问题,但各家处理态度差异明显:

-

微软: 唯一一家积极响应并且已完成修复的企业。

-

谷歌及其他厂商: 谷歌起初按高危处理,随后以“过度依赖社会工程学”为由降级并关闭;多数厂商则认为该问题超出其安全防护范围。

安全专家提醒:在处理由 AI 审核的网页脚本或命令时务必保持警惕,切勿完全依赖 AI 的合规性审查。

© 版权声明

AI智能体所有文章,如无特殊说明或标注,均为本站作者原创发布。任何个人或组织,在未征得作者同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若此作者内容侵犯了原著者的合法权益,可联系客服处理。

THE END

用户38505528 8个月前0

粘贴不了啊用户12648782 9个月前0

用法杂不对呢?yfarer 9个月前0

草稿id无法下载,是什么问题?