近日,阿里巴巴通义实验室(Tongyi Lab)语音团队携手中国科学技术大学推出的 Fun-CineForge 项目正式宣布开源。面向影视配音中的口型对齐、音色克隆与情感呈现等关键痛点,项目给出了一条端到端的制作流程与大模型方案。

核心突破:瞄准影视配音“出戏”难题

以往的 AI 配音常常出现口型不齐、情绪生硬,还难以胜任复杂影视场景(如对白和多人混响)等问题。Fun-CineForge 通过以下两项关键创新带来显著提升:

-

MLLM 配音模型:不再仅靠唇部区域做音视频对齐,而是采用多模态大模型(MLLM)框架,可深入理解场景中的角色身份与情绪变化。

-

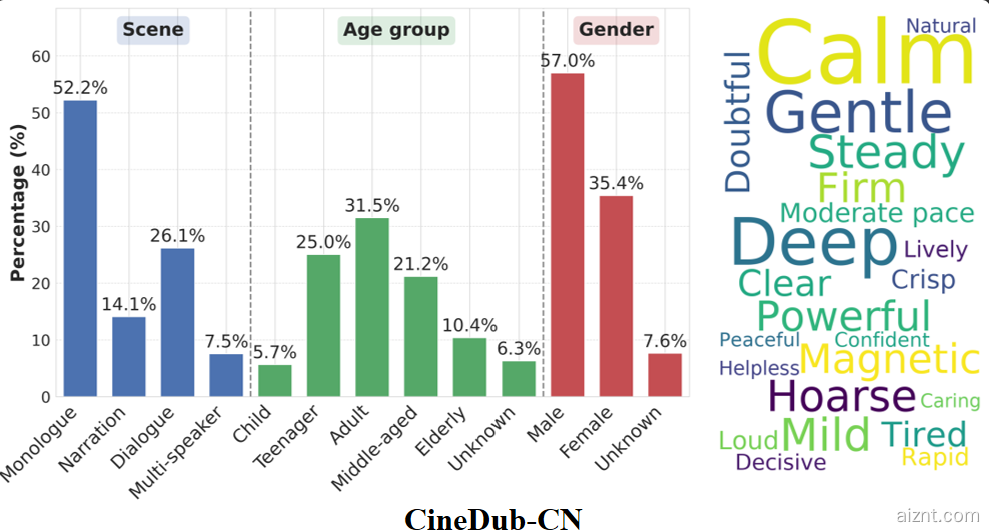

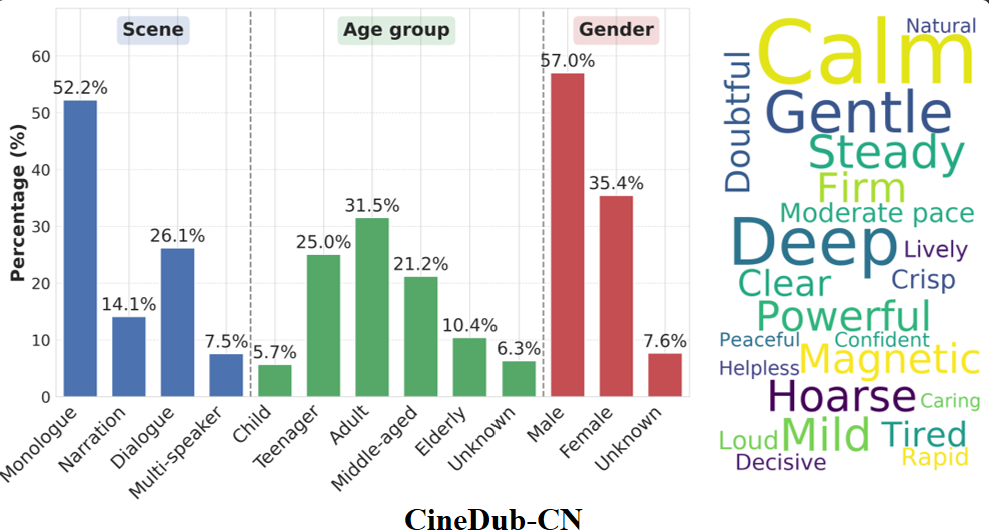

CineDub 大规模数据集:通过自动化流程打造首个含丰富标注的中文电视剧配音数据集,覆盖独白、旁白、对话及多说话人等多种场景。

项目进展与开源安排

该项目近期更新密集,展现出极高的工程成熟度:

-

2026年1—3月:先后放出中文版(CineDub-CN)与英文版(CineDub-EN)数据集样本及演示 Demo。

-

2026年3月16日:正式开放推理代码与模型权重(Checkpoints),开发者可在 GitHub 获取。

-

数据集获取:目前已提供《红楼梦》(中文)与《唐顿庄园》(英文)等经典剧目的数据集样本,供研究使用。

技术实战:从“对话”走向“表演”

从官方展示的 Demo 看来,该模型在《三国演义》等经典剧集的再创作中表现出色。通过输入特定的“情感线索(Clue)”,模型能准确捕捉角色从恐惧到反抗的情绪变化,实现高保真的音色迁移与自然的口型对齐。

Fun-CineForge 的发布,意味着影视 AI 配音从基础的“文字转语音”升级为具备艺术理解力的“自动化后期”,有望显著降低译制片与影视后期的制作成本。

项目:https://funcineforge.github.io/

用户38505528 8个月前0

粘贴不了啊用户12648782 9个月前0

用法杂不对呢?yfarer 9个月前0

草稿id无法下载,是什么问题?