面向 AI 视频生成长期存在的“角色不一致”和“环境闪烁”问题,字节跳动与南洋理工大学研究团队联合发布了 StoryMem。该系统引入类似人类记忆的机制,让长视频在跨场景创作中保持高度一致,解决了 Sora、Kling 等模型在多镜头叙事里常见的视觉偏差。

StoryMem 的核心在于独特的“混合记忆库”。研究人员发现,把所有场景硬塞进同一个模型会让计算成本飙升,而分段生成又容易丢失关联。为此,StoryMem 会选择性地保存前序场景的关键帧作为参考。系统采用双重筛选:先用语义分析挑出视觉重点帧,再用质量检测剔除模糊图像。生成新场景时,这些关键帧会配合 RoPE(旋转位置嵌入)输入模型。通过给记忆帧设置“负时间索引”,模型会把它们理解为“过去的画面”,从而在故事推进中保持角色与背景的稳定一致。

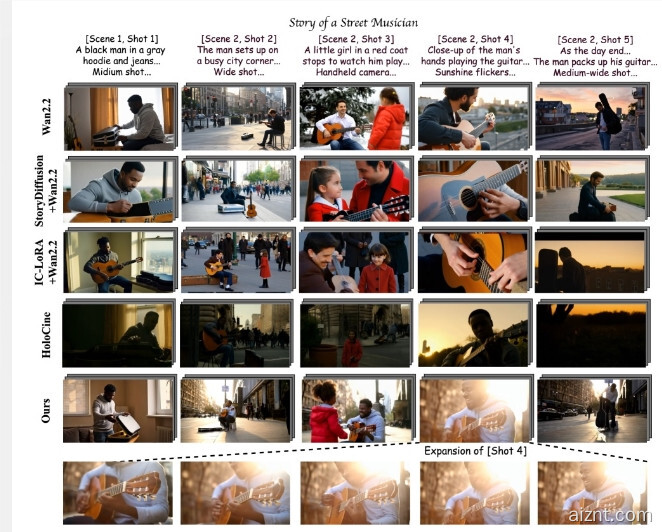

更值得一提的是,StoryMem 的实现非常高效。它基于阿里巴巴开源模型 Wan2.2-I2V 的 LoRA 版本运行,在140亿参数的基础模型上仅增加约7亿参数,大幅降低了训练门槛。在包含300条场景说明的 ST-Bench 基准中,StoryMem 的跨场景一致性相较基础模型提升了28.7%,在美学评分和用户偏好上也全面领先于 HoloCine 等前沿方案。

此外,该系统还具备极高的实用性,支持用户上传自定义照片作为“记忆起点”,生成更连贯的故事,并带来更顺滑的场景过渡。尽管在多角色同场与大幅度动作衔接方面仍有局限,但团队已在 Hugging Face 开放权重,并上线项目页面供开发者探索与体验。

地址:https://kevin-thu.github.io/StoryMem/

https://huggingface.co/Kevin-thu/StoryMem

用户38505528 8个月前0

粘贴不了啊用户12648782 9个月前0

用法杂不对呢?yfarer 9个月前0

草稿id无法下载,是什么问题?