据报道,Meta AI 研究团队近日发布了名为 Pixio 的图像模型研究,证明即便采用更简单的训练路线,也能在深度估计和 3D 重建等复杂视觉任务中取得优异表现。长期以来,学界普遍认为掩码自编码器(MAE)在场景理解上不如 DINOv2 或 DINOv3 等更复杂的方法,但 Pixio 的问世打破了这一固有印象。

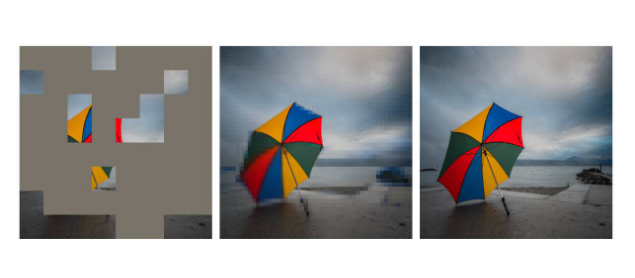

Pixio 的核心思路来自对 2021 年 MAE 框架的深度升级。研究者发现,原始设计中偏弱的解码器限制了编码器的潜力,于是显著增强了解码器能力,并扩大了图像的遮挡区域。把零散的小块遮挡改为大面积连续遮挡后,Pixio 不能再靠简单“复制像素”过关,而是必须真正学会图像中的物体共现、3D 透视和反射等空间关系。此外,借助多个用于汇聚全局属性的类别标记,模型能更准确地捕捉场景类型、相机角度与光照信息。

在训练策略上,Pixio 追求极高的纯粹性。不同于 DINOv3 针对特定基准(如 ImageNet)反复调优,Pixio 从网络收集了 20 亿张图像,并采用动态频率调整:降低简单产品图的权重,增加复杂场景的训练次数。这种不为测试集“刷分”的做法,反而带来了更强的迁移能力。

对比结果显示,仅有 6.31 亿参数的 Pixio 在多项指标上超过了 8.41 亿参数的 DINOv3。在单目深度估计中,准确率提升了 16%;在 3D 重建任务里,即便只用单张图像训练,Pixio 也优于使用八视角训练的 DINOv3。同时,在机器人学习领域,Pixio 以 78.4% 的成功率领先 DINOv2。研究团队也表示,人工掩蔽仍有局限,后续将探索视频预测方向。但目前的成果已充分说明:回到像素重建的本质,往往能通向更深层的视觉理解。

用户38505528 8个月前0

粘贴不了啊用户12648782 9个月前0

用法杂不对呢?yfarer 9个月前0

草稿id无法下载,是什么问题?